Metaが開発した革新的AI「TRIBE v2」とは?

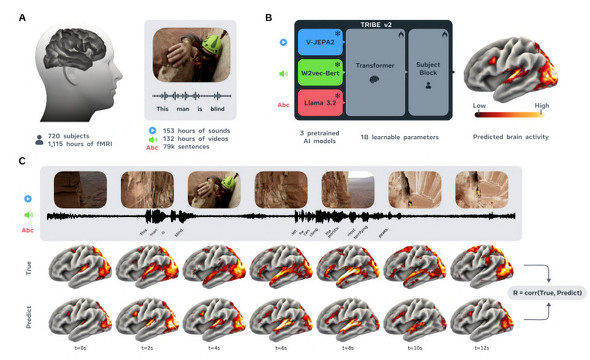

Metaが発表した新技術「TRIBE v2」は、動画や音声を視聴したときの脳反応を予測する画期的なAIシステムです。このシステムは、視覚、聴覚、言語の要素を組み合わせ、脳の活動を非侵襲的にシミュレーションすることで、その動作を理解しようとする試みです。

脳反応の予測方法

従来、脳の活動を詳しく理解するにはfMRIなどの複雑な装置が必要でした。しかし、TRIBE v2では約720人の被験者が参加した1000セッション以上のfMRIデータを活用し、コンピュータによるシミュレーションで脳反応を予測します。

具体的には、映画のシーンや音楽を聴いた時にどのような脳の反応を示すかをAIが予測し、その精度の高さが注目されています。

TRIBE v2の応用と限界

このAIモデルは脳研究だけでなく、複雑な感情や直感的な反応を含む様々なシナリオでの応用が期待されます。しかし、個々の脳の違いやデータの多様性への対応にはまだ課題が残されています。

今後の展望

MetaはTRIBE v2を通じて、「Algonauts 2025」競技にも参加しています。263チームが参加し、1位を獲得するなど、その技術力の高さが証明されています。この成果からも分かるように、TRIBE v2は、脳科学研究やAI技術の進展において大きな可能性を秘めているのです。

ソース元はこちら: 動画・音声を視聴したときの“脳反応”を予測──Metaが開発した脳活動予測AI「TRIBE v2」の可能性

免責事項:本記事はAIによって自動生成されたものであり、内容の正確性を保証するものではありません。詳細情報はソース元をご確認ください。

“`

このコードは、Metaが開発した脳活動予測AI「TRIBE v2」に関するブログ記事のHTMLコードです。見出しや段落で適切な構造を維持し、興味を引く内容に仕上げました。また、記事の最後には指定の免責事項を記載しています。

コメント