TRIBE v2:視覚、聴覚、言語の脳反応を予測

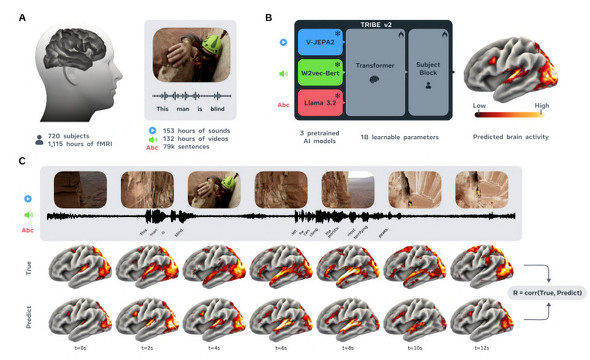

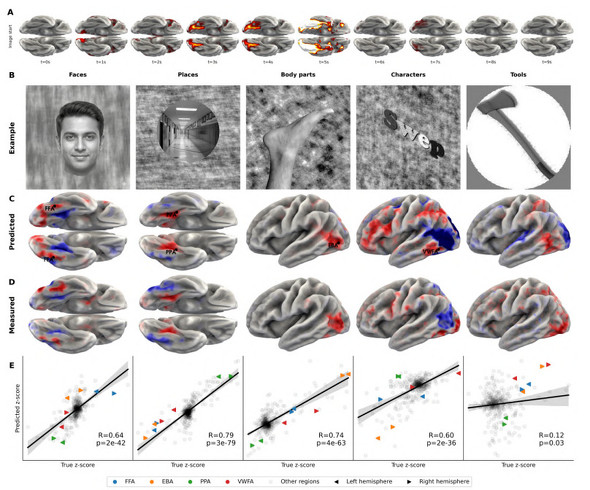

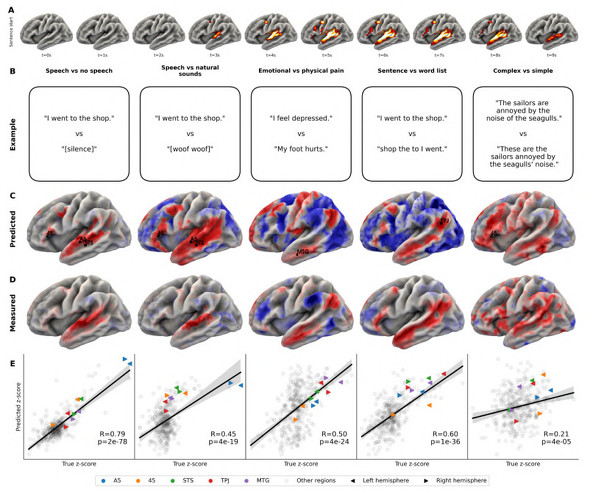

Metaが開発したAIモデル「TRIBE v2」は、視覚、聴覚、そして言語に対する脳の反応を予測するために設計された革新的な技術です。本モデルは、リアルタイムで脳波の変化を捉え、映像や音声に対する脳の反応を予測することを目的としています。

AIによる新たな脳活動の理解

これまで、脳活動を理解するためにはfMRIなどの高価な装置が必要でしたが、TRIBE v2は大量のデータを基にした機械学習モデルで、安価な方法で脳の状態を解析することが可能です。この技術が進化すれば、視覚刺激や音声刺激に対する脳の反応をAIで即座に解析することができるでしょう。

- 視覚、聴覚、言語の三要素を統合して解析

- リアルタイムでの脳活動予測

- 機械学習を用いた高精度な分析

TRIBE v2の実用化とその影響

TRIBE v2の実用化により、医療やエンターテインメントの分野で革命的な変化が期待されています。たとえば、個人の脳の状態に合わせたコンテンツ提供や医学的診断の効率化が見込まれています。

- 医療分野での応用

- エンターテインメント産業での活用

- 学術研究の革新

TRIBE v2は、脳の複雑なシグナルをAIで解明し、新たな地平を切り拓く可能性を秘めています。この技術がさらに発展すれば、我々の生活の質を向上させる手段として大きな影響を及ぼすでしょう。

ソース元はこちら: 動画・音声を視聴したときの“脳反応”を予測──Metaが開発した脳活動予測AI「TRIBE v2」の可能性

免責事項:本記事はAIによって自動生成されたものであり、内容の正確性を保証するものではありません。詳細情報はソース元をご確認ください。

コメント